Goed nieuws voor wie zich ergert aan de wildgroei aan systemen voor gezichtsherkenning. Canadese onderzoekers hebben een privacyfilter ontwikkeld die er in slaagt gezichtsherkenningssoftware om de tuin te leiden.

Telkens je een foto of video van jezelf op sociale media zet, leert gezichtsherkenningssoftware iets meer over jou. Die software is inmiddels zo ver ontwikkeld dat die een foto vrijwel foutloos kan identificeren. Algoritmen nemen bovendien gegevens op over wie je bent, over je locatie en over de mensen die je kent.

Als reactie hierop hebben onderzoekers van de universiteit van Toronto een algoritme ontwikkeld om die gezichtsherkenningssoftware te verstoren. Hun oplossing maakt gebruik van een kunstmatige intelligentie-techniek die adversarial training wordt genoemd. Daarbij worden twee algoritmen tegen elkaar opgezet. De onderzoekers ontwierpen een set van twee neurale netwerken: de eerste werkte aan het identificeren van gezichten en de tweede werkte aan het verstoren van de gezichtsherkenning. De twee vechten voortdurend tegen elkaar, leren van elkaar en zetten een voortdurende AI wapenwedloop op. Als de eerste bijvoorbeeld op zoek is naar de ooghoek, past de tweede de ooghoek aan zodat deze minder opvalt. Dat veroorzaakt nauwelijks waarneembare verstoringen in de foto, maar die zijn belangrijk genoeg om het systeem voor de gek te houden.

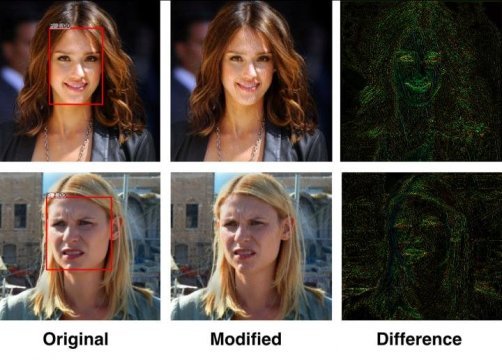

Het resultaat is een Instagram-achtig filter die op foto’s kan worden toegepast om de privacy te beschermen. Hun algoritme verandert zeer specifieke pixels in het beeld, waardoor veranderingen worden aangebracht die bijna niet waarneembaar zijn voor het menselijk oog. Maar die veranderingen zijn dus wel voldoende om de software voor gezichtsherkenning om de tuin te leiden. Bovendien verstoort de privacyfilter ook zoekacties op basis van beelden, identificatie van kenmerken, inschatting van emoties en etniciteit en alle andere gezichtskenmerken die automatisch kunnen worden afgeleid.

De onderzoekers testten hun systeem op de 300-W dataset, een standaardpool met meer dan 600 foto’s van een breed spectrum aan gezichten. Ze konden daarmee aantonen dat hun systeem het aandeel van herkende gezichten kon terugbrengen van bijna 100 procent naar 0,5 procent.

De onderzoekers hopen de privacyfilter binnenkort voor iedereen toegankelijk te maken via een app of website.